作者:恰似故人归

https://zhuanlan.zhihu.com/p/2023482883415835093

这两年大家谈 LLM post-training,常见的叙事是两条线:

- 一条是 outcome reward 的 RL

- 一条是 teacher 提供 dense signal 的 knowledge distillation。

近半年来 On-policy distillation(OPD)之所以越来越火,原因也很直接:它不像纯 SFT 那样只学 teacher 生成过的轨迹,也不像 outcome-RL 那样 reward 太稀疏——集合on policy以及dense reward于一身,这似乎是非常理想的通往AGI的一块拼图。

然而,天上并不会掉馅饼,我们不禁会问:这么容易就能拿到的dense reward真的就一定好用吗?我们使用它真的就一点代价都没有吗?

🧪Title: Rethinking On-Policy Distillation of Large Language Models: Phenomenology, Mechanism, and Recipe

📝Paper: https://huggingface.co/papers/2604.13016

💻Code: https://github.com/thunlp/OPD

如果觉得这篇工作不错的话,欢迎点点upvote 和 star~

前言

从 Qwen3、Mimo-Flash 到 GLM-5 系列,大家似乎达成了一种默契——让学生模型自己生成轨迹,然后用更强教师模型的 per-token log-prob 作为密集奖励(Dense Reward)来引导更新。

在直觉上,这种做法太合理了。它彻底绕开了 Off-policy 蒸馏里最头疼的暴露偏差(Exposure Bias)问题,让模型能在自己真正会访问的状态空间里获得纠偏信号,看似是SFT的完美平替。

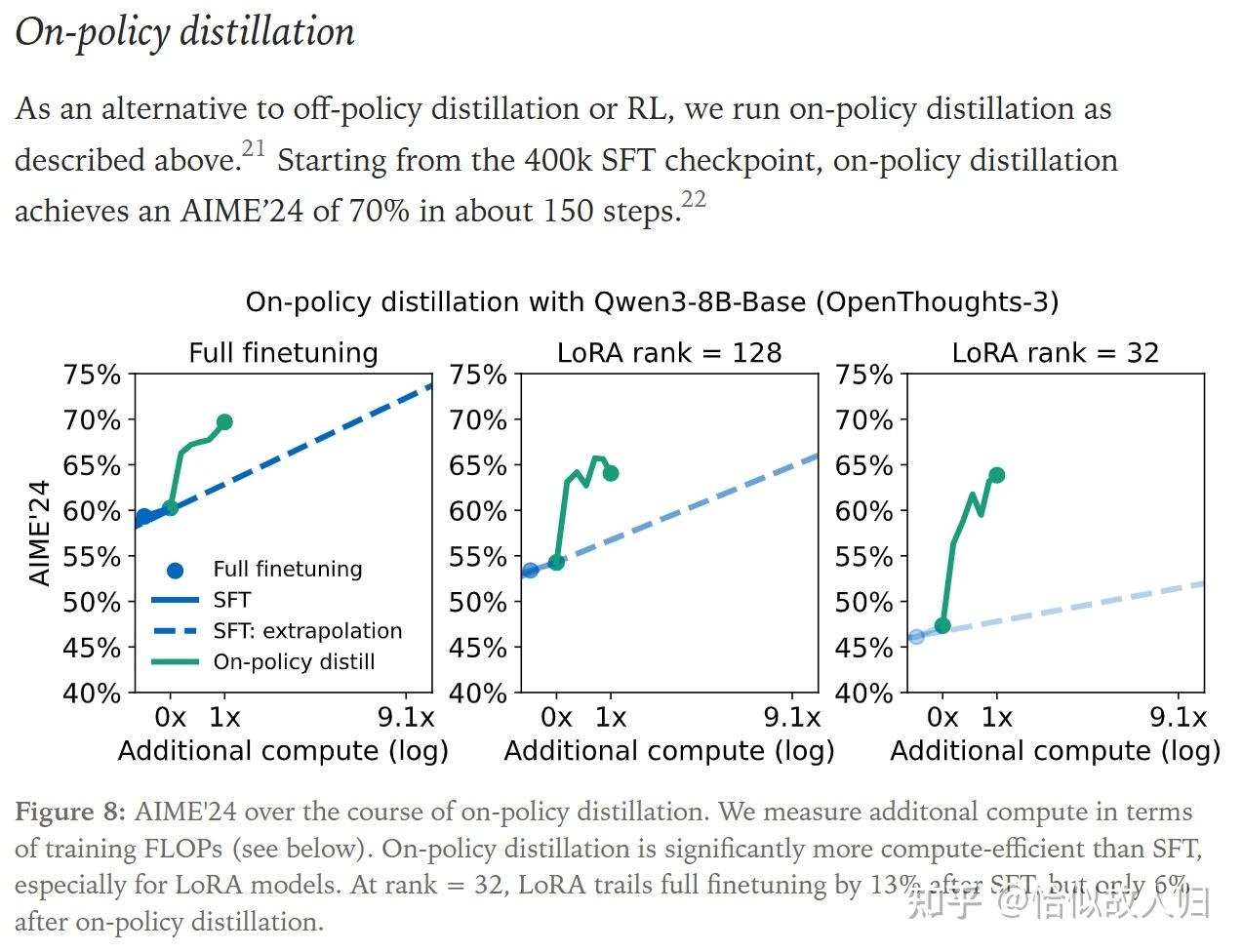

10月底,Thinking Machines Lab提出的 OPD (On-Policy Distillation) 同时结合了RL (Reinforcement Learning) 的On-policy特性以及KD (Knowledge Distillation) 的Dense Reward特性,blog展示的这个方法不仅蒸馏的效率远远高于传统的SFT (Supervised Fine-Tuning),并且还不会发生灾难性遗忘——这看似是SFT的一个完美的平替。

道理听起来很合理,但现实中OPD的训练过程往往不尽如人意——在哪种条件下能跑通,在哪种条件下会失败,其实并没有系统性的答案。我们做的就是把这个问题从头到尾拆开来看清楚。

我们从三个层面递进推进。

第一层是"现象学" (Phenomenology):我们通过一系列对照实验,归纳出OPD成功的两个前提条件——老师和学生要有相容的思维模式 (thinking pattern) ,以及老师必须给学生带来真正新的知识,而不只是同一套训练数据在更大模型上的另一个版本。

第二层是"机制" (Mechanism):深入到token level去看,成功的OPD有一个清晰的动态特征:训练过程中,学生和老师在高概率token上的overlap会持续扩大,这些overlap token承载了97%到99%的概率质量,也集中了几乎全部有效的梯度信号。

第三层是"配方" (recipe):在摸清了失败原因之后,我们提出了两个实用的策略,来让OPD的效果更好。

OPD Framework

原始的OPD使用的是一个使用在response token上的 Teahcer 和 Student的log-prob的差值来估计Reverse-KL的,一个很自然的改进就是做的更加细粒度一点的估计,即在每个position处使用top-k token之间的KL来做估计,具体的公式如下

其中 s_t 是代表 student 的 top-k 候选token,使用top-k估计的方差会更小,同样也便于我们更好的观测相关的training dynamic.

打开黑盒,直击本质

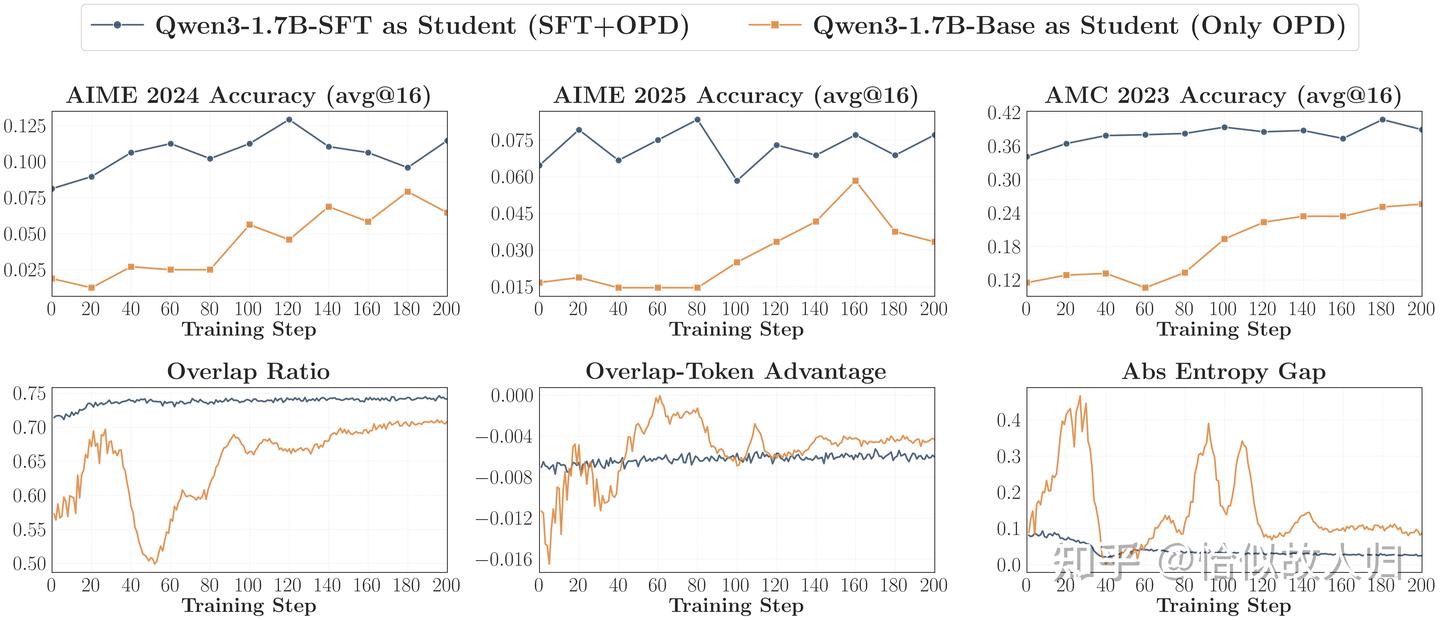

我们没有直接盯最终 benchmark,而是设计了一组training dynamics:overlap ratio、overlap-token advantage、entropy gap:

- Overlap Ratio: Student 和 teacher 的 top-k 高概率 token 集合的交集比例。衡量两者在同一状态下"想说的词"有多少重叠。

- Overlap-Token Advantage: 在交集 token 上,teacher 和 student 的概率分布对齐程度。接近零说明 student 已经在 teacher 认可的 token 上配置了合理的概率质量。

- Entropy Gap: Teacher 和 student 在 student 生成路径上的熵差的绝对值。差距缩小意味着两者的"确定性程度"趋于一致。 这么做的原因很简单:如果不看训练过程,你只能知道“有没有涨分”,但不知道在训练过程中 student 的分布到底是怎么被 teacher 推着走的。

OPD Phenomenology

在深入探讨 OPD 的 Token 级机制之前,我们首先在宏观层面需要厘清一个核心问题:到底是什么决定了 OPD 的有效性?

传统的知识蒸馏经验通常认为,“Teacher 的能力越强,Student 的蒸馏上限就越高”。但在实际的 OPD 实验中,我们观察到了一个与直觉相悖的现象:

有时,一个在 Benchmark 上得分更高的强模型,不但无法带来可观的蒸馏收益,甚至会导致学生模型能力的退化;而某些跑分相对较低的模型,却能作为极佳的 teacher 引导学生实现性能跃升。

为了探究这一现象背后的根本机制,我们设计了一系列控制变量实验,最终发现 OPD 的成败实际上受制于两个不可忽视的先决条件。

Thinking pattern consistency:teacher 和 student 得先“说得到一块去”

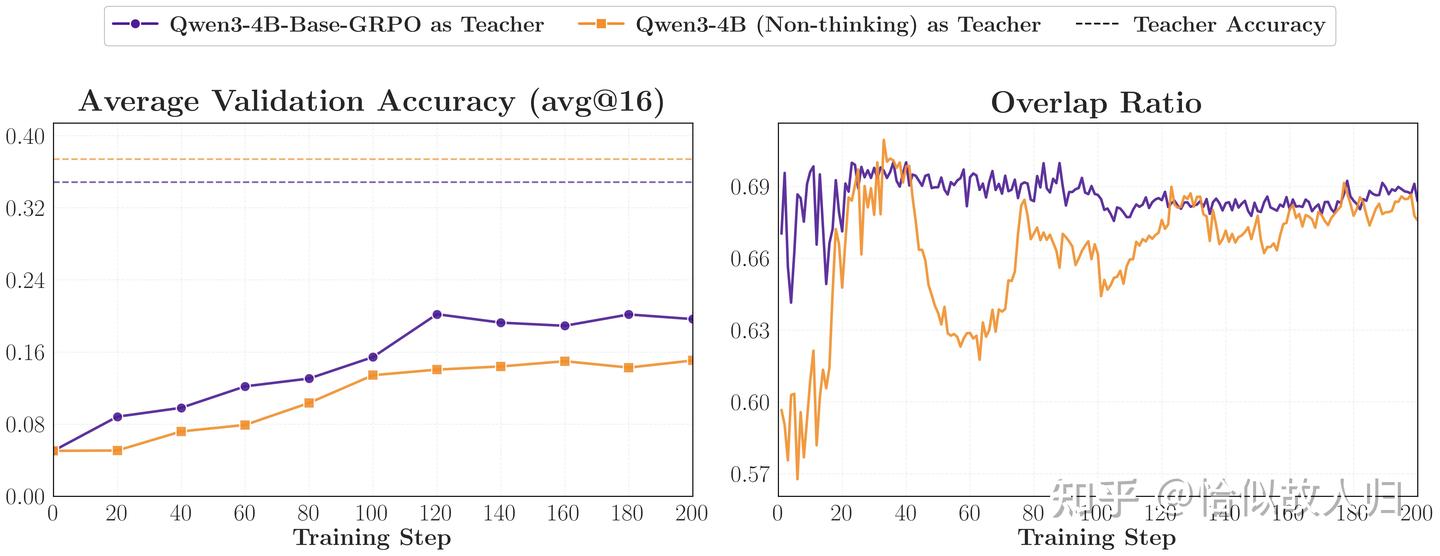

我们做了一组对比实验:固定 student 为 Qwen3-1.7B-Base,teacher 选的一个是不开思考模式 (Non-thinking) 的 Qwen3-4B,一个是对Qwen3-4B-Base 直接做 Zero-RL (GRPO) 的 Qwen3-4B-Base-GRPO。

单看数学 Benchmark 的平均得分,GRPO 老师其实是不如常规 4B 老师的。但蒸馏结果却恰恰相反,跟随 GRPO 老师训练的学生模型最终获得了更显著的性能提升。

背后的原因在于,由于Student 本身是 Base 模型,它的thinking patttern与同样源自 Base 的 GRPO teacher 更为契合。我们在training dynamic中证实了这一点:这两者在训练初期的 Overlap Ratio(即师生在候选 Top-k Token 上的重合度)要高得多。

这说明,在 OPD 框架下,如果师生在thinking pattern上存在严重mismatch,teacher 即便具备更强的解题能力,其提供的 Token leverl的指导信号也很难被 Student 转化为有效的梯度更新,而且这种早期不匹配造成的优化损失在后续训练中是难以弥补的。

高分不等于新知识(Higher scores ≠ new knowledge)

那么,如果thinking pattern一致了,是不是只要teacher model更大、跑分更高,就万事大吉了?

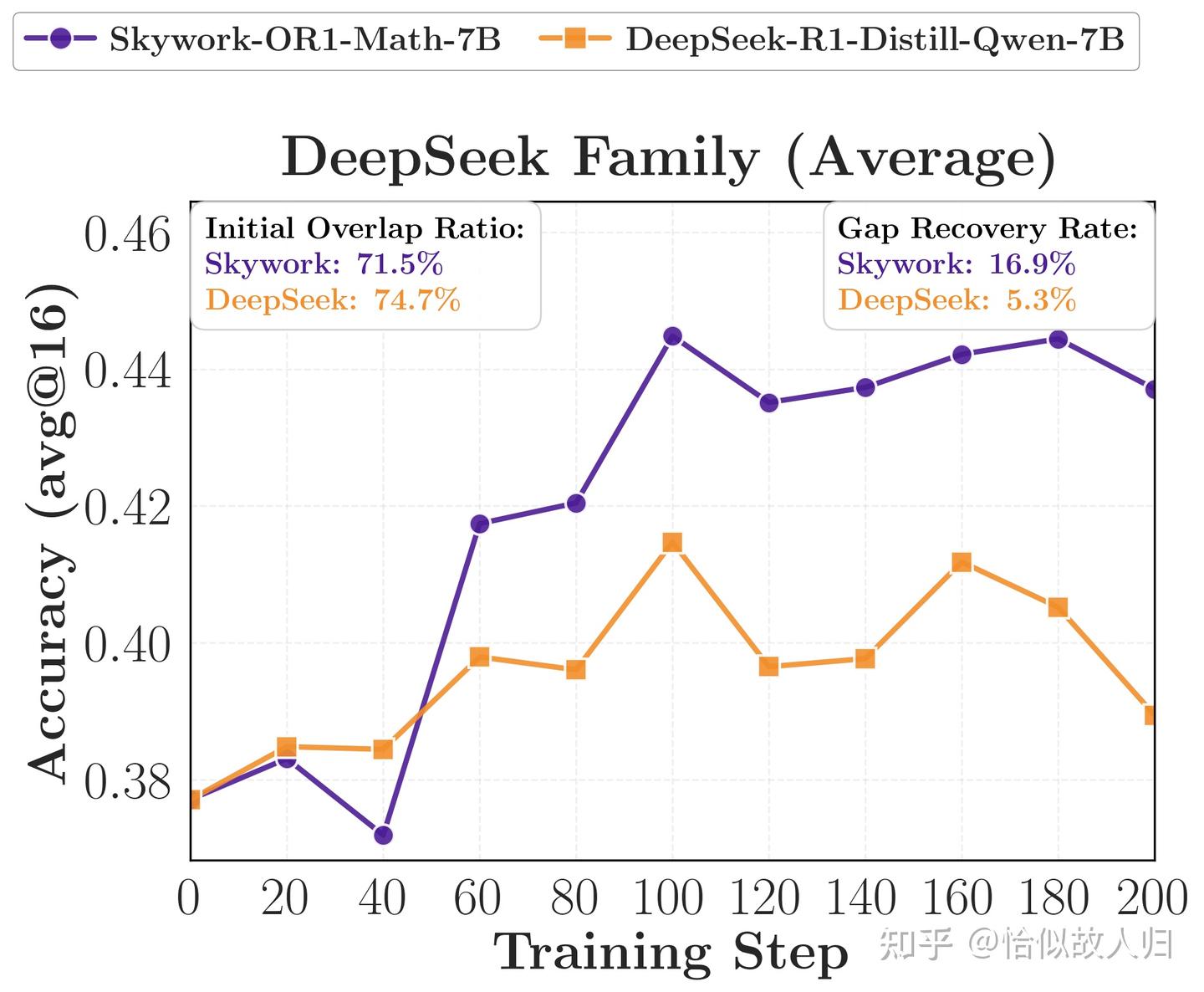

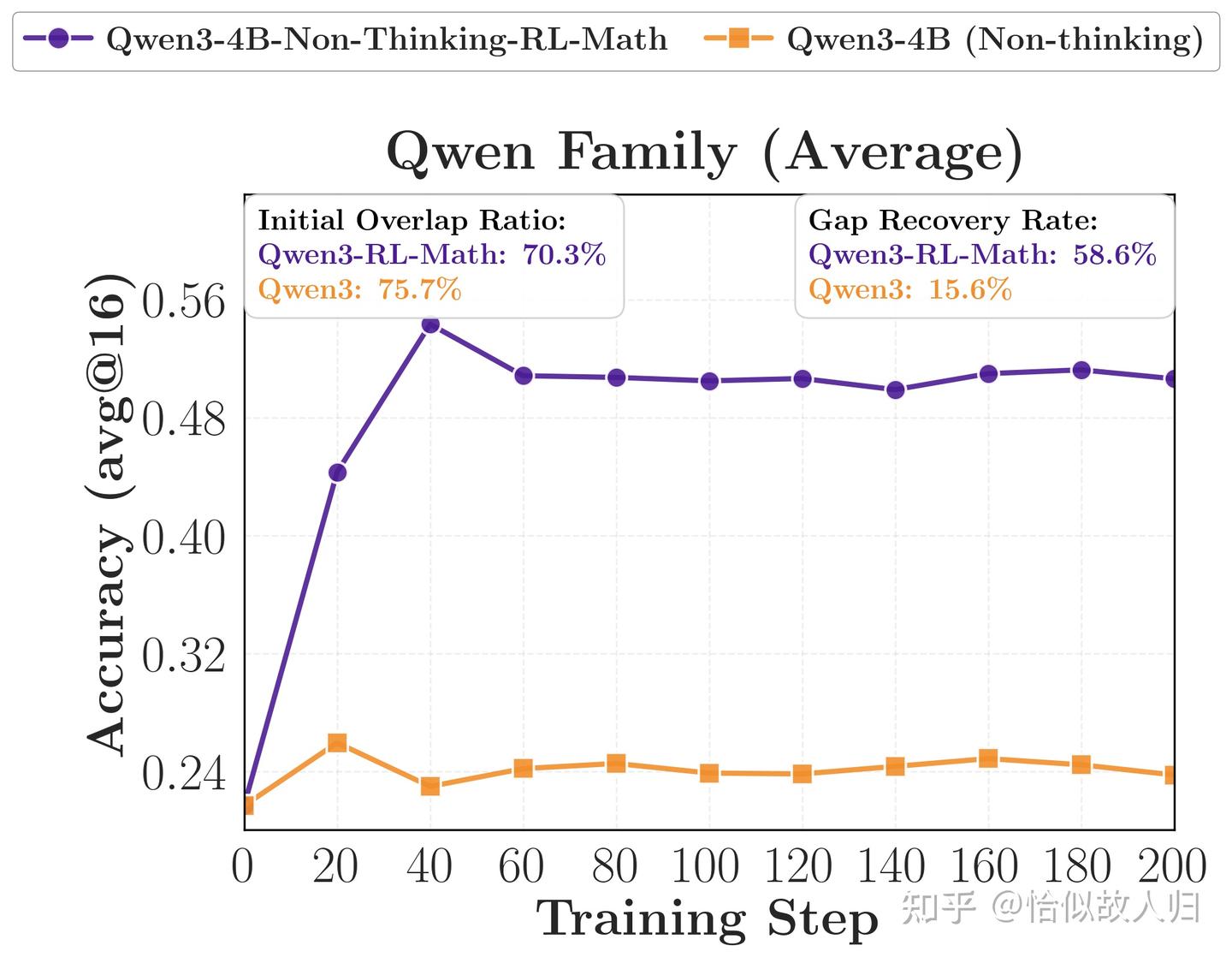

事实并非如此。我们在 DeepSeek 和 Qwen 两个family里做了测试,对比了“同源但更大尺寸的teacher” (DS-7B 和 Qwem3-4B) 和“经过额外 RL 后训练注入了新能力的teacher” (Skywork 7B和Qwen3-4B-Math-RL) 。

结果非常明显,如果Teacher仅仅是把参数量从 1.5B 放大到了 7B,用的还是同一套数据和训练配方,那哪怕它的跑分比学生高,蒸馏带来的提升也微乎其微。

这意味着,在同源放大(Scaling)的设定下,两者的局部概率分布已经非常相似,Teacher 侧几乎没有增量信息(Information Gain);OPD 要想发挥威力,teacher 必须向 student 传授其在此前训练阶段未曾见过的新知识。

一个有意思的实验:Reverse Distillation

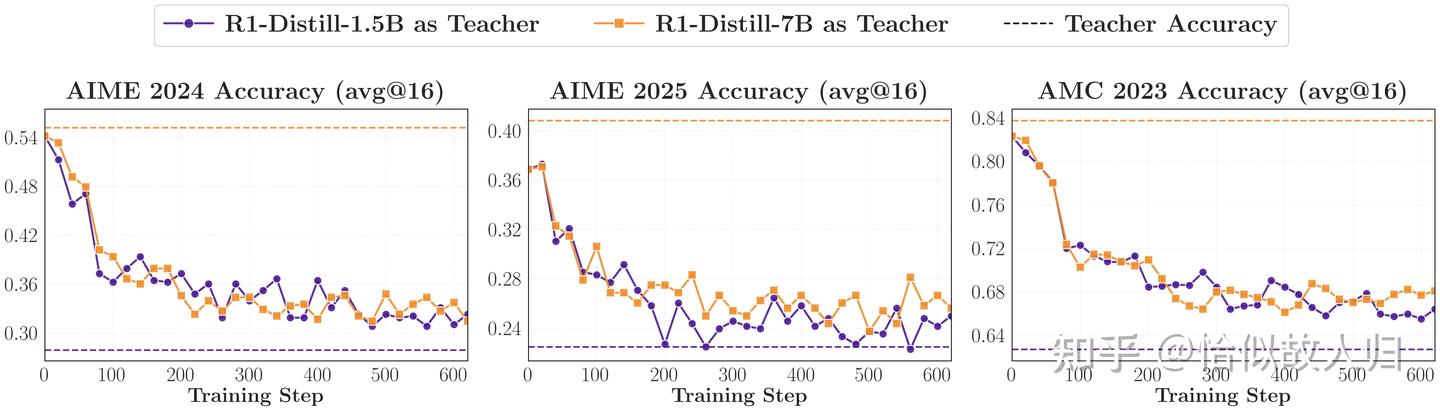

为了严谨地验证这两点,我们设计了一组反向蒸馏(Reverse Distillation)实验,这也是我们认为揭示 OPD 动力学本质最直观的证据。

我们把一个已经由DeepSeek-R1-Distill-Qwen-1.5B经过 RL 得到的、能力很强的 JustRL-Deepseek-1.5B 拿来当Student,然后选择两个同族的teacher:一个是RL之前的base model (DeepSeek-R1-Distill-Qwen-1.5B),另一个是尺寸更大的DeepSeek-R1-Distill-Qwen-7B. 注意,7B Teacher的跑分是比当前这个还要略微高的。

关于 JustRL-1.5B,具体详见Bingxiang 学长@朵朵菊花向阳开 的工作 ,他也是这篇工作的共同一作之一,欢迎大家follow~

周二晚8点!一起聊聊JustRL,只用最基础的 RL 配方也能达到不错的性能!

实验结果令人深思:无论面对哪个teacher,JustRL-1.5B 均发生了严重的性能退化,并且两条训练曲线最终几乎精准地倒退回了同一水平(即 RL 之前的性能)。

这说明了什么?首先,7B 和 1.5B 由于出自相同的训练管线 (pipline),在student视角的局部状态下,这俩 teacher 诱导出的目标分布几乎是不可区分的;其次,OPD 训练动态完全可以与 teacher 的 benchmark 分数解耦。

即便 7B teacher的分数更高,由于它缺乏 RL 阶段注入的新知识,其提供的监督信号本质上是在迫使学生“遗忘”好不容易习得的强化学习策略,退化回陈旧的生成模式。

综合这部分的观察,我们可以得出一个结论:OPD 并不是在单纯地“学习高分”,而是在主动提取并复刻 teacher 的概率分布模式。思维模式的一致性保证了这种复刻的可行性,而 teacher 侧真实的增量知识 (information gain) 则决定了复刻带来的性能上限。

既然 OPD 的宏观前提是概率分布的匹配与新知识的注入,那么当这些条件被满足时,这种对齐在具体的 Token 级别究竟是如何体现的?下一步,我们将把视角切入到微观的训练动态中,去看看在成功的 OPD 背后,Token 层面的分布到底发生了怎样的演化。

OPD Mechanism

上一部分我们明确了 OPD 成功的宏观前提:thinking pattern的匹配与新知识的注入。既然如此,当这些条件被满足或破坏时,在微观的 Token leverl到底发生了什么?为了回答这个问题,我们将观测尺度深入到了token-level的training dynamic中。

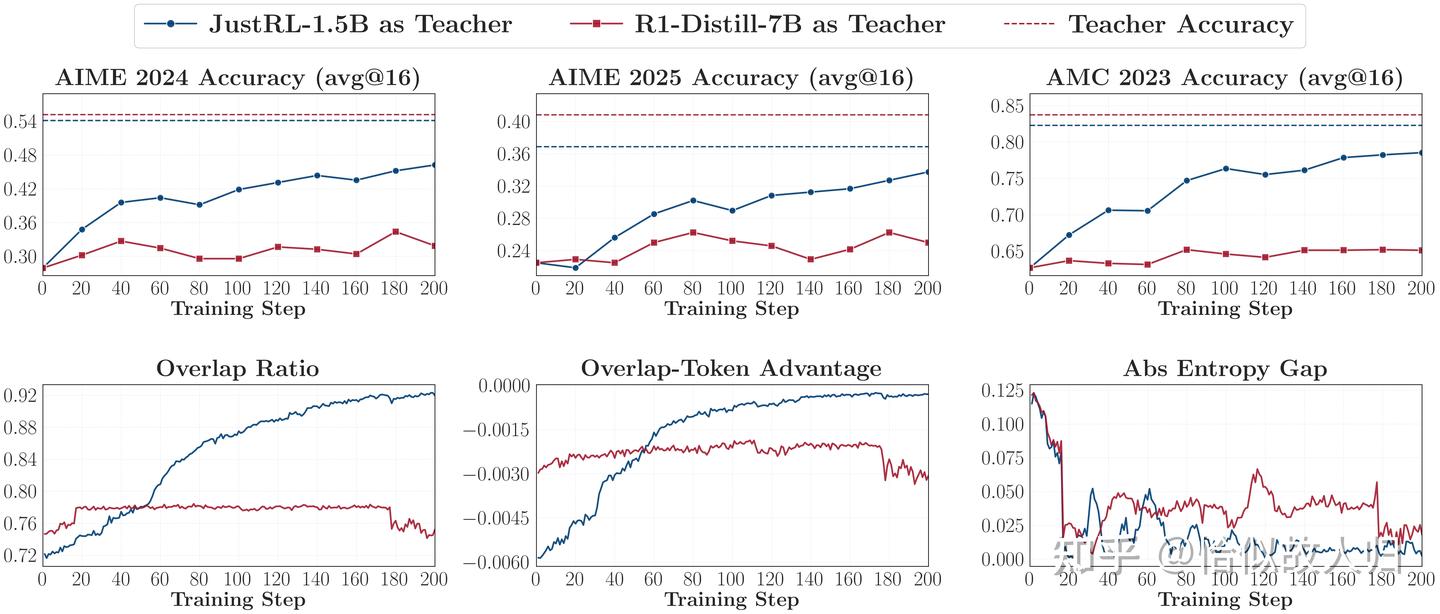

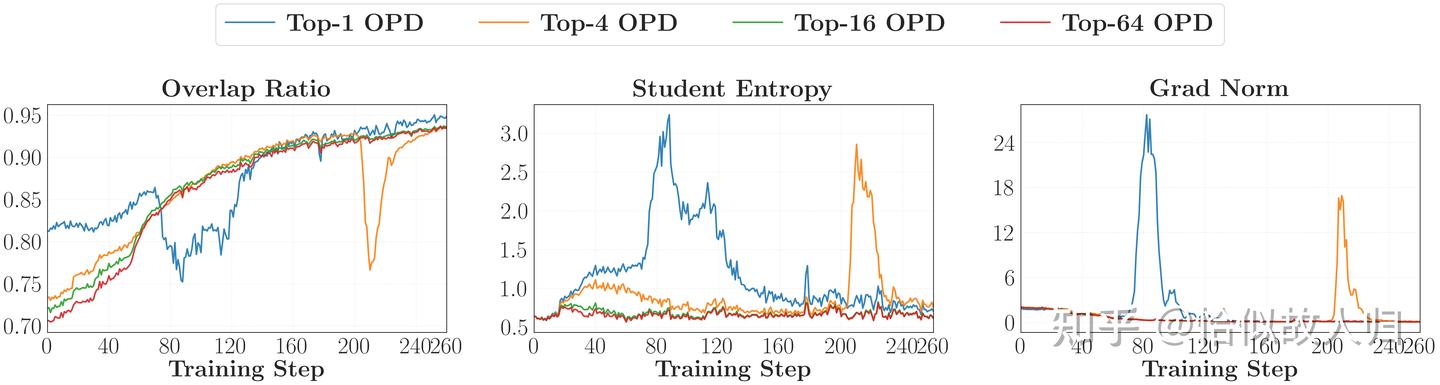

Progressive Alignment of High-Probability Tokens

我们依然沿用前面的典型对照组:以 R1-Distill-1.5B 为学生,对比成功的 Teacher(JustRL-1.5B)和失败的 Teacher(R1-Distill-7B)。这一次,我们在训练的每一步都监控了三个核心指标:Overlap Ratio(师生在 Top-k 候选 Token 上的重合度)、Overlap-Token Advantage(重合 Token 的优势值对齐情况)以及 Entropy Gap(两者在相同状态下的信息熵差距)。

成功的蒸馏过程展现出了一种极具标志性的“渐进对齐”(Progressive alignment)特征。在成功的OPD中,我们观察到师生之间的 Overlap Ratio 随着训练步数稳步攀升(从约 72% 一路涨到了 91% 以上),同时优势值向零收敛,熵差距不断缩小。

这意味着,学生在自己生成的trace上,不仅逐步定位到了老师也偏好的高概率 Token,而且正在精确校准自身在这些 Token 上的概率,使之与老师保持一致。反观 7B Teacher的失败对照组,这三个指标从一开始就陷入停滞,几乎没有变化。

更关键的是,我们统计后发现,虽然师生重合的 Top-k Token 在词表中只占极小的一部分,但它们实际上承载了双方 97% 到 99% 的概率质量(Probability Mass)。这说明,高概率 Token 的对齐并不是细枝末节的副产物,而是核心概率分布演化的主轴。

Optimizing Shared Tokens Alone Suffices

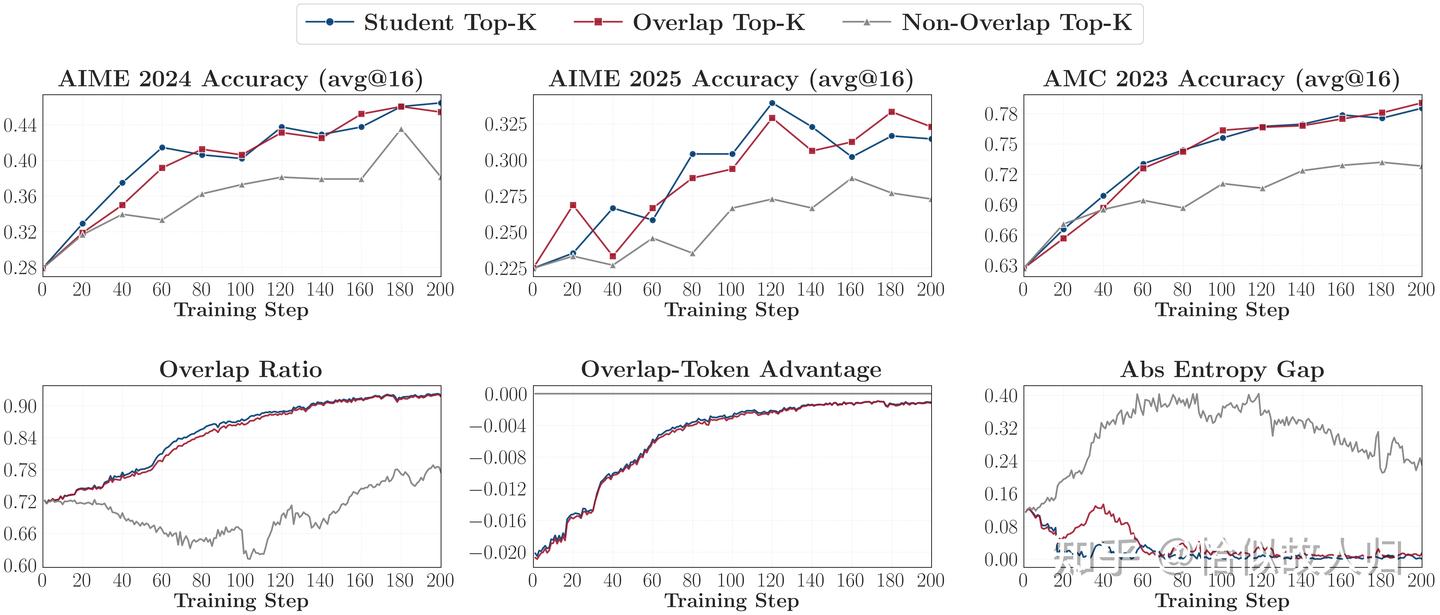

既然OPD的成功伴随着高概率token的对齐,那么这两者是否有因果关系呢? 为了搞清楚这一点,我们设计了一个具有针对性的消融实验(Ablation Study)。

我们把常规的 Top-k 监督信号强行拆解成了互斥的两部分:一个版本我们仅仅在师生重合的 Token 上计算蒸馏损失(Overlap Top-k),另一个版本我们只在双方不重合的差异 Token 上计算损失(Non-Overlap Top-k).

实验结果给出了非常明确的答案:仅仅在 Overlap Token 上进行优化,就足以几乎完美复现标准 Top-k OPD 的全部性能增益!而仅仅依靠 Non-Overlap Token 训练出来的模型,性能则大幅落后。

这个发现说明 OPD 的绝大部分有效梯度来自于在双方都已经认可的“高概率Overlap Token 集合”里,精准地进行概率权重的再分配。额外那些Non-Overlap Token,其实并没有贡献多少有价值的优化信号。

到这里,我们其实就看清了 OPD 共作的一个“飞轮效应”(Self-reinforcing dynamic)

当师生在初始阶段存在合理的思维模式重合时(满足我们在第一部分提到的条件),老师会对这些共享的 Token 给出明确的打分。Reverse-KL 散度的优化目标会促使学生将概率质量更集中地倾注到这些被老师认可的重合 Token 上。

随着重合 Token 的概率越来越高,那些原本不重合的边缘 Token 就自然而然地被“挤出”了学生的 Top-k 集合。结果就是,重合区因为优化而变得更大,优化信号又因为重合区的扩大而变得更加纯粹和稳定,形成了一个良性循环。

相反,如果初始阶段师生的思维模式严重错位,重合区太小,或者老师在重合区内无法提供高于学生的“新知识”信号,这个飞轮就会从一开始卡死,从而导致我们在失败组里看到的停滞现象。

理清了这套微观机制后,一个非常实际的问题自然浮现:既然初始的重合度(Overlap Ratio)如此重要,那么当我们拿到一个和学生思维模式差异很大、但又确有真才实学的强力 Teacher 时,难道只能束手无策吗?我们能否通过某种工程手段,人为地帮它们把这个“飞轮”先转起来?

Practical Recipe

答案是肯定的。既然thinking pattern的初始鸿沟 (gap) 会阻碍 OPD 的生效,那我们完全可以在真正开始 OPD 之前,先搭两座桥,人为地把状态拉近。基于前面的现象和机制分析,我们总结了两条非常实用的策略(Practical Recipe),专门用来盘活那些原本可能会失败的OPD配置。

Off-policy Cold Start

在之前我们已经明确指出thinking pattern的mismatch会显著影响OPD的效果。为了缓解这种错位,我们引入了一个两阶段框架:先做传统的 SFT作为Cold Start,再做 OPD。

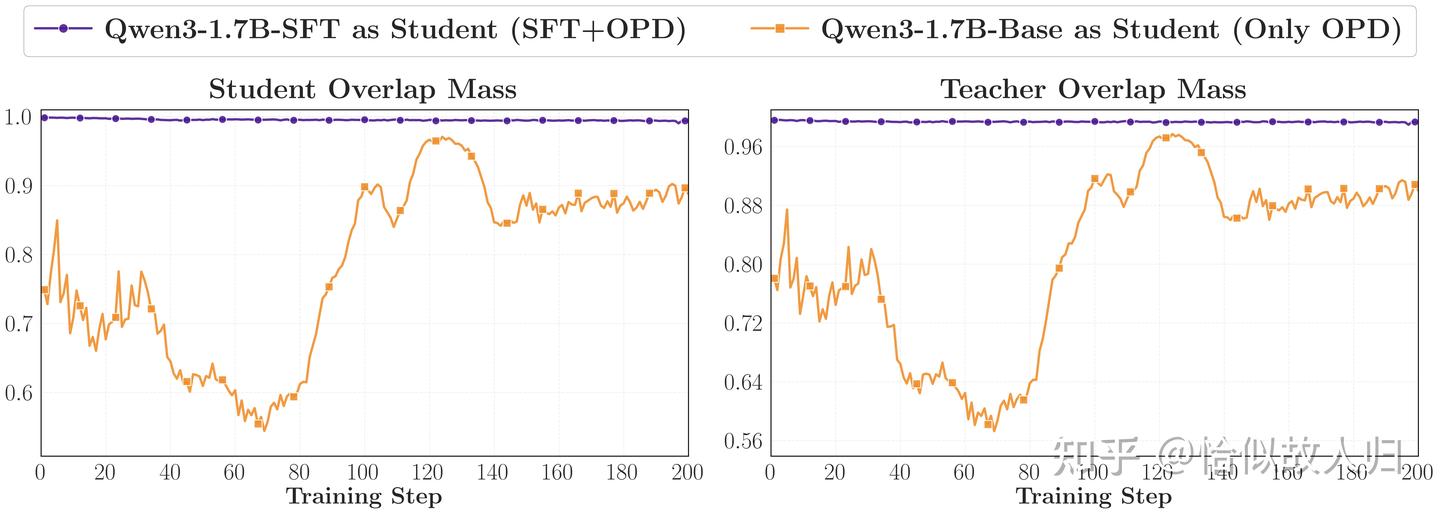

具体怎么做呢?我们让Qwen3-4B (Non-thinking) 作为 teacher 先offline 生成一批回答,简单filter之后,用这批数据对 Base 版本的Student model(Qwen3-1.7B-Base)做一次 SFT。相当于在实战前,先让student 背一背teacher的“优秀范文”,强行把学生的生成偏好往teacher的thinking pattern上拽。在此基础上,我们再启动正式的 OPD 训练。

实验结果证明,这一招极为有效。相比于从 Base 模型直接硬上 OPD,经过 SFT 冷启动的student在各项 Benchmark 上的最终表现都有了实质性的飞跃,并且最终的上限也显著更高。

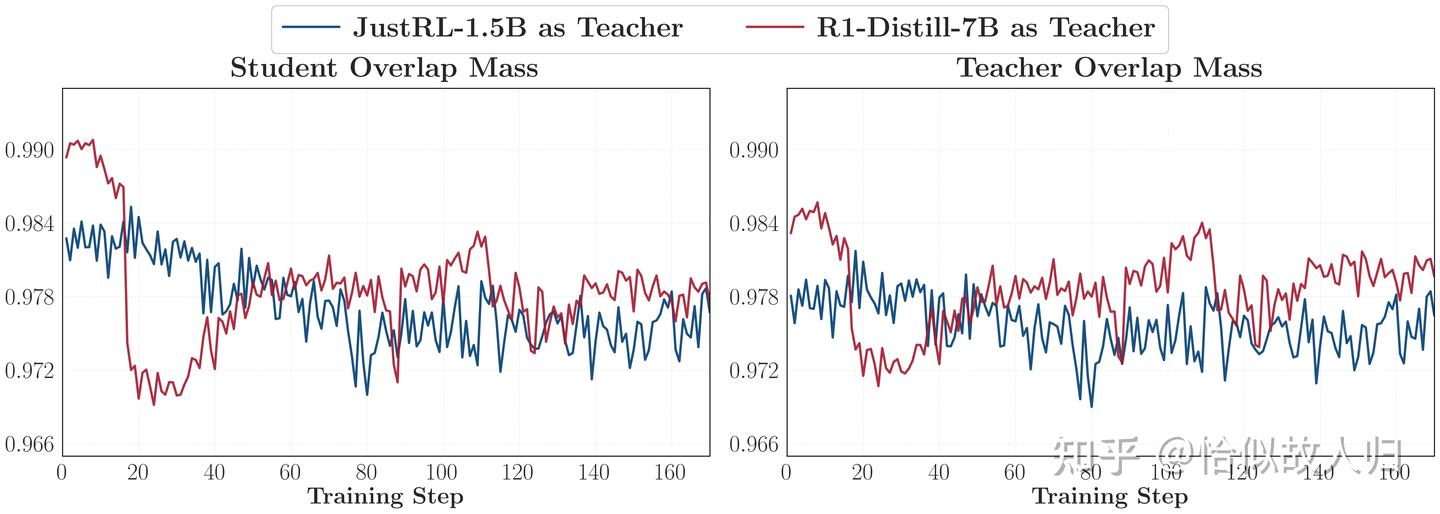

透过我们上一部分提到的微观指标来看,原因非常清晰:SFT 直接拉高了训练初始阶段的 Overlap Ratio,并且大幅压低了师生之间的 Entropy 差距。

而且我们进一步分析了 Overlap Mass(重合 Token 占据的总概率质量),发现 SFT 后的studnet一开始就能稳稳覆盖teacher高概率的核心区域。

这就好比学生提前预习了老师的讲课风格,OPD 开始的第一步,前面提到的那个“渐进对齐飞轮”就直接转起来了,不仅起步更稳,最终的天花板也更高。

Leveraging Teacher Post-Training Prompts

我们的第二招是从数据端入手:利用训练Teacher所使用的prompt来做OPD(Teacher-aligned prompt selection)。

Teacher的评估偏好是在它自己的后训练(比如 RL)阶段被塑造的。那么,如果我们在 OPD 时使用的 Prompt 能够尽量贴合老师当时的训练环境,是不是能获得更高质量的监督信号?我们将这种对齐拆分为两个颗粒度:模板对齐 (template) 和内容对齐 (content)。

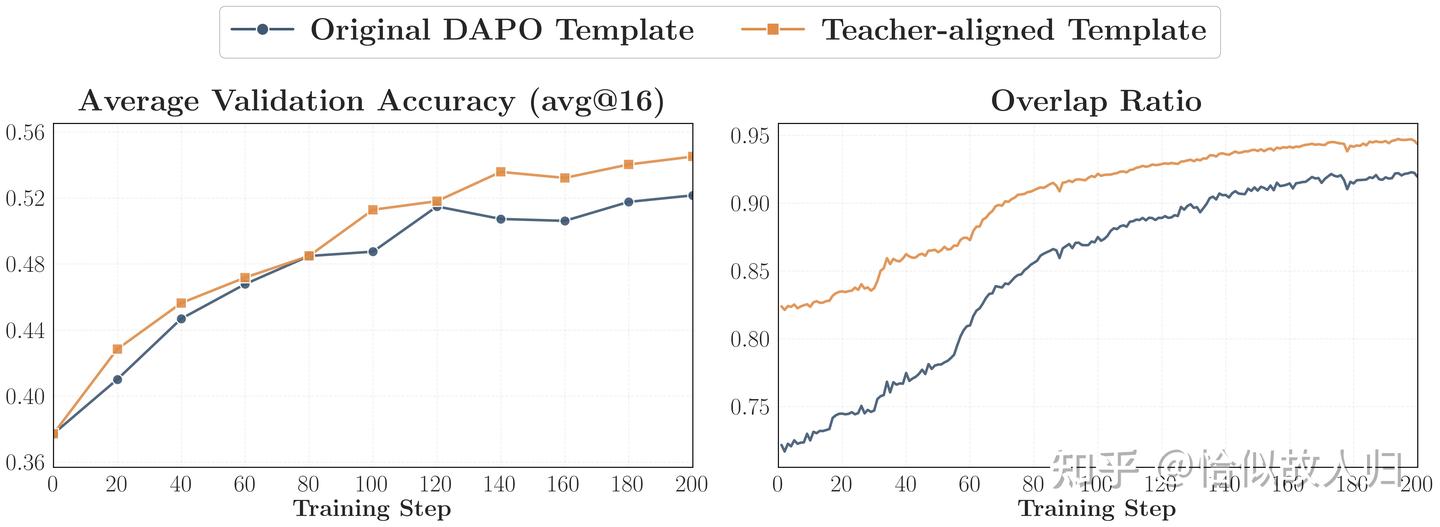

在Template对齐的实验中里,我们仍然选择JustRL-1.5B作为teacher和R1-Distill-1.5B作为student. 我们只做了一个很小的改动:把 DAPO-Math-17K 的指令模板 (template),从原本的标准风格,换成 “Please reason step by step, and put your final answer within \boxed{}.” 模板,这个模版是JustRL在RL时使用的。

问题的内容一模一样,变的只是template。结果却很明显:teacher-aligned template 不仅验证集更高,overlap ratio 也起得更高、涨得更快。这个结果很说明问题——哪怕只是 prompt format 不对齐,都会影响 student 到底会把自己带到哪些状态上,从而影响 teacher 的 token-level supervision 是否真正可用。

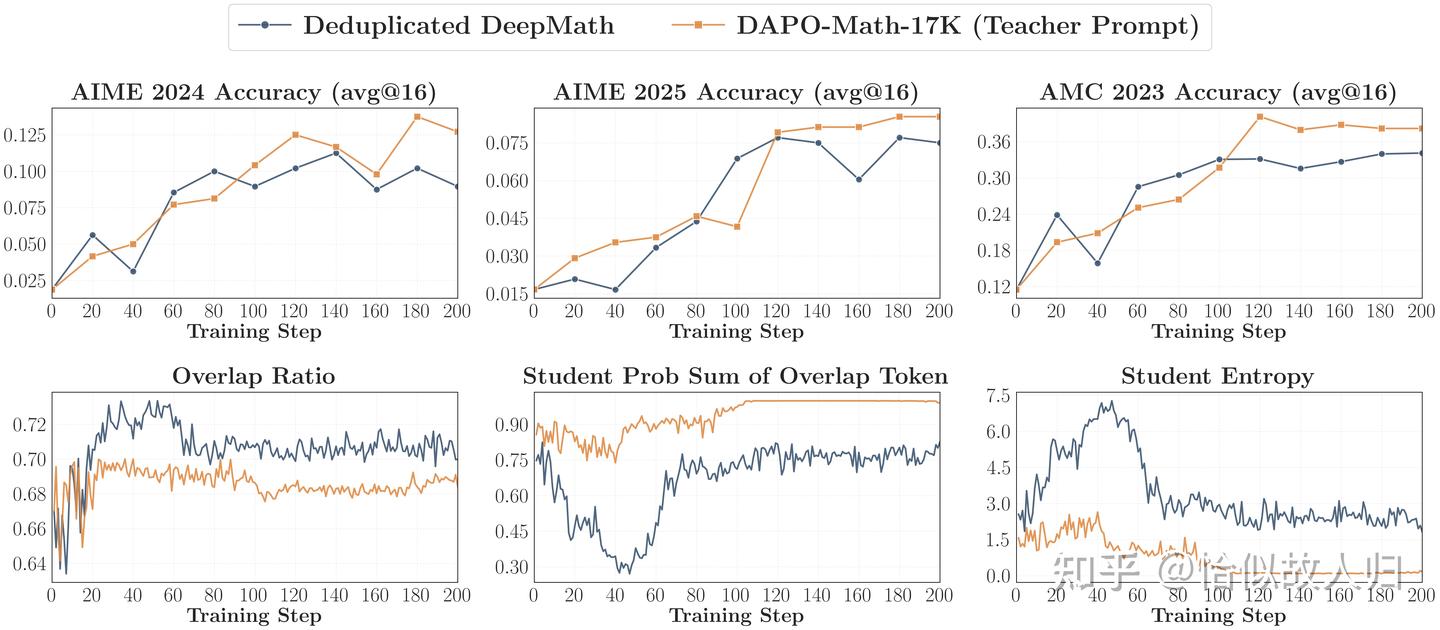

然后是 Prompt 内容的对齐,也就是直接复用Teacher在做后训练时见过的那些题目。我们复用了Phenomenology一章中提到的实验,选取Qwen3-4B-Base-GRPO作为teacher,Qwen3-1.5B-Base作为student.

我们发现:用和 teacher RL 训练集一致的 DAPO-Math-17K prompt 去做 OPD的最终效果显著比和DAPO去重过的 DeepMath 子集更好。表面上看,这个 teacher-aligned prompt 的 overlap ratio 反而更低;

但如果看 overlap token 上累计的 student probability mass,会发现其实使用teacher prompt的对齐反而好,因为高概率token全部是overlap的,overlap ratio低更像是高概率集中在了少数几个token的后果。

但是我们在实验中观察到,如果极其严苛地只用teacher 训过的 prompt 去做 OPD,student在训练过程中的entropy会发生灾难性的坍塌。这意味着student会失去了探索其他可能性的空间。

因此,一个更鲁棒的实操策略是:在保留部分 Teacher-aligned prompts 以获取精准的高频对齐信号的同时,一定要混入一些OOD的prompt,以此来维持学生策略的多样性,防止模型因为过度拟合teacher的特定偏好而发生熵坍塌。

通过 SFT 冷启动和 Prompt 对齐这两手准备,我们不仅能在大部分情况下保证 OPD 的成功率,还能有效提升最终的蒸馏收益。但故事到这里并没有结束。Token-leverl Reward这种看似“免费的午餐”,其实暗中标好了极其昂贵的价格,尤其是在面对长文本推理时。接下来,我们将揭示 OPD 的一些局限性。

Discussion: Dense reward 不是没有代价

在Discussion部分其实我们想提醒另一件事:dense token-level supervision 并不是没有代价。它的代价恰恰来自“on-policy”这三个字。

teacher 每一步都在 student 自己走出来的 prefix 上打分;prefix 越长、漂移越深,teacher给的reward就越不可靠。

Reward Quality Degrades with Trajectory Depth

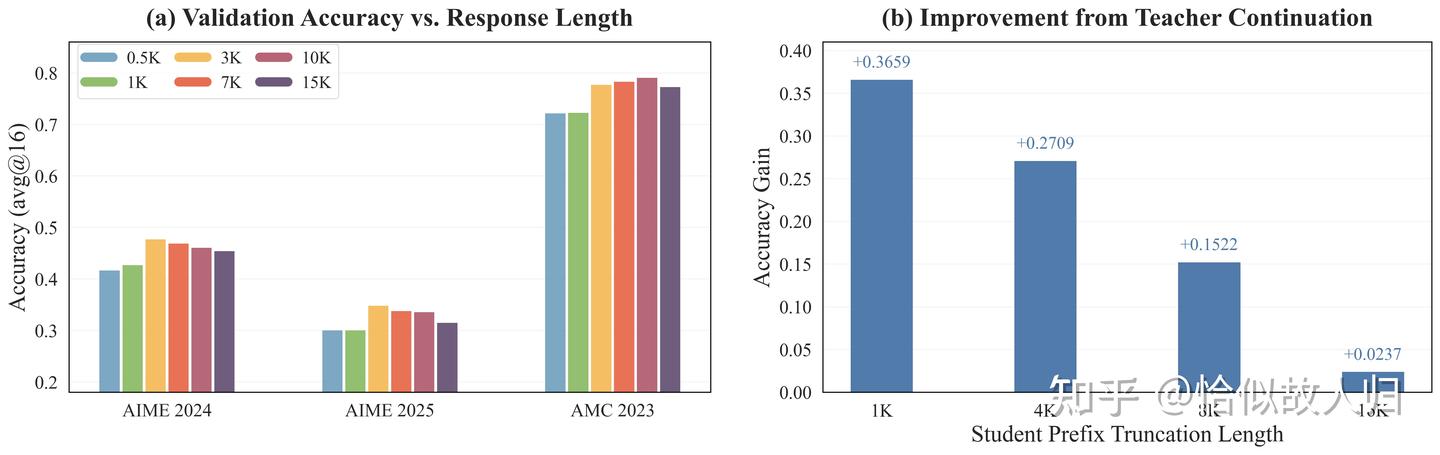

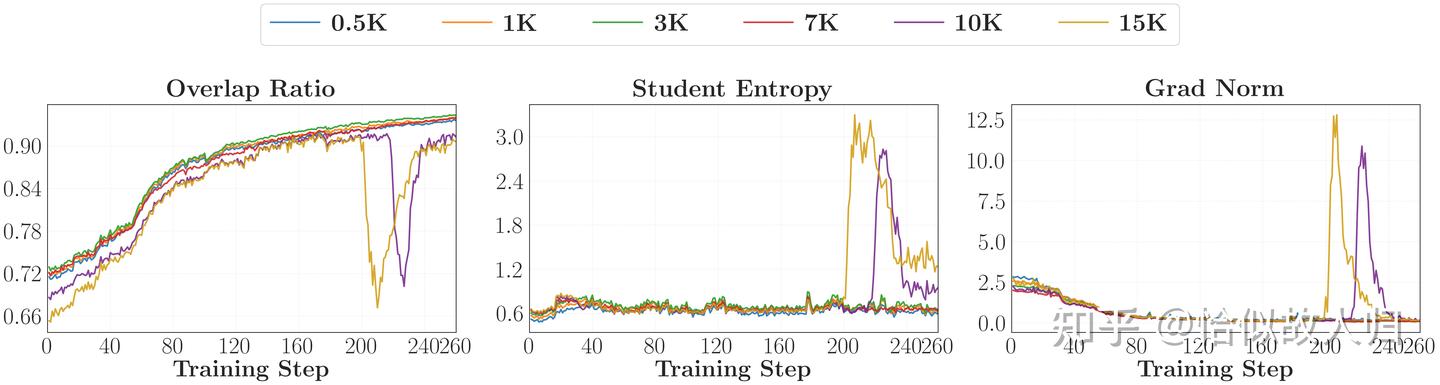

我们做了一个有关response length的消融实验。用 R1-Distill-1.5B / JustRL-1.5B 这组原本成功的设定,把最大 response length 扫到 0.5K、1K、3K、7K、10K、15K。

结果不是越长越好,而是很明显存在一个 sweet spot:太短,监督不够;中等长度,3K 和 7K 最稳;再往上到 10K、15K,效果开始平台甚至回落,而且训练后期会出现明显的不稳定。

值得一提的是:有一些工作也观测到了类似的现象,有兴趣的读者也可以看看下面的工作。

重探 On-Policy Distillation(OPD):三类典型失败以及修复路径

Revisiting On-Policy Distillation: Empirical Failure Modes and Simple Fixes

Fast and Effective On-policy Distillation from Reasoning Prefixes

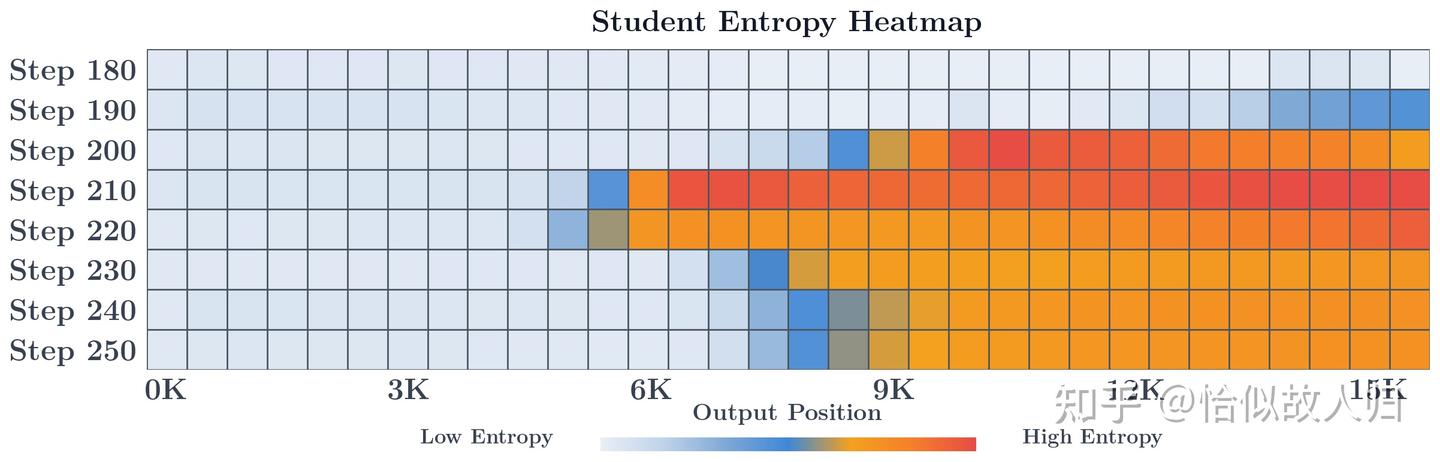

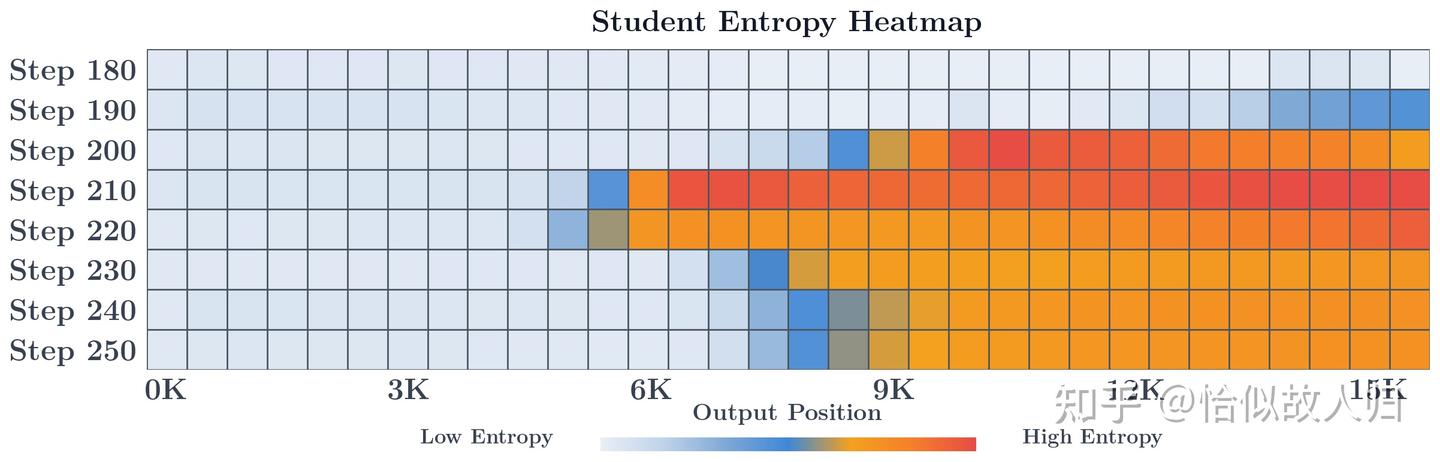

我们进一步研究了不稳定的根源。对 15K settings,我们画了 student entropy 在不同 decoding position 上随training steps的热力图,发现高熵区域不是随机出现的,而是先从很后面的 suffix 出现,再一路往前扩散。

我们还做了一个非常直观续写实验(见b图):把 student 自己生成的长回答截断在不同 prefix depth,让 teacher 从这些 prefix 往后续写,再和 student 原来的 continuation 比较。

结果很残酷:从 1K prefix 接着写,teacher 还能比 student 多带来大约 +0.37 的准确率提升;截到 16K,这个优势只剩下 +0.02。

这同样也说明了,teacher 在靠前的位置给出的reward的质量更高,但是随着ouput position增加,teacher给出的 dense reward 基本就快失真了,甚至是噪声。

对长时程 reasoning、agentic multi-turn 任务来说,这可能就是 OPD 很难线性外推的一道硬边界。

Globally Informative Reward Does Not Guarantee Local Exploitability

明白了长文本的不可靠,我们再来解答之前留下的一个悬念:在第四部分的实验里,那个跑分更高、同家族的 7B teacher,为什么就是教不会 1.5B 的student?难道是这个大尺寸的teacher的奖励信号全局就打错了?

为了探究原因,我们计算了序列平均奖励的分布。结果显示,无论是成功的 Teacher 还是失败的 Teacher,它们给正确轨迹打出的平均分都显著高于错误轨迹,两者的 AUROC(0.73-0.75)几乎持平。

这说明,失败的 Teacher 并不是“分不清好坏”,它的全局奖励信号依然是富有信息的(Informative)。我们由此提出了“局部优化几何学”(Local optimization geometry)的假设:尽管全局信号是正确的,但该 Teacher 在各位置上产生的 Token 级优势值(Advantage)可能是高度各向异性(Anisotropic)的。

具体而言,当这些在不同位置上指向冲突的局部信号被聚合成一次梯度更新时,它们在方向上发生了严重的相互抵消,导致最终产生的有效梯度模值极小。相比之下,成功的 Teacher 虽然在 Benchmark 跑分上未必占优,但它与学生共享相似的思维模式,其提供的信号在局部具有更强的一致性,能够产生更明确、更易于学生利用的优化梯度。

这说明,一个在全局有区分度的奖励信号,并不等于它在局部是可以被学生榨取和利用的。

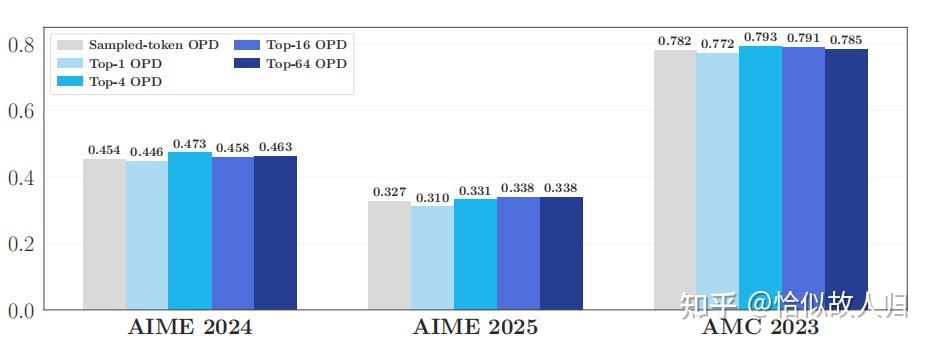

Sampled-Token Reward Is Already Sufficient

最后,我们在工程落地层面还探讨了一个非常务实的问题:既然 OPD 是靠高概率Overlap Token 驱动的,那我们每次在单个位置上,到底需要计算多少个候选 Token(即 Top-k 的 k 取多少)才能保证梯度质量?

我们对比了计算 Top-64、Top-16、Top-4、Top-1,以及Thinking Machines Lab提到的、最常用的sampled token OPD.

出乎意料的是,计算量最小的 Sampled-token,效果竟然和拉满 Top-64 几乎一样好。而同样只用了一个 Token 的 Top-1 策略,却在训练后期全盘崩溃,引发了剧烈的梯度和熵震荡。

为什么同样是单 Token,差距这么大?这一差异源于采样性质的不同。Sampled-token 本质上是对应 Token 级 Reverse KL 的无偏蒙特卡洛估计,它能够以概率分布的方式覆盖整个高概率支撑区(Support region)。而 Top-1 这种确定性的选择规则,会导致奖励信号对策略的微小偏移极其敏感——只要 Token 的排序发生翻转,梯度方向就会产生剧烈的跳变。

因此,从实际工程落地的角度来看,OPD 的成功并不依赖于极高密度的词表覆盖,而在于提供一个无偏且覆盖高概率区域的监督信号。只要避开像 Top-1 这样容易导致模式坍塌(Mode-seeking instability)的退化设置,低成本的单 Token 采样方案就足以支撑起高质量的策略蒸馏。

写在最后:个人碎碎念

这篇工作实际上始于去年11月份我们复现原始OPD的效果并没有想象中的好。为了研究原因,我们做了非常丰富的实验,我们尝试过的所有 OPD pairs如下,这其中有的效果非常好(大多是同尺寸的实验),但是大部分的实验结果并不能很好地恢复teacher的性能。经过大量的实验我们才有足够的信心去share我们发现的一系列结论。

| Student Model | Teacher Model |

|---|---|

| DeepSeek-R1-Distill-Qwen-1.5B | JustRL-DeepSeek-1.5B |

| DeepSeek-R1-Distill-Qwen-7B | Skywork-OR1-Math-7B |

| Qwen3-1.7B-SFT (Thinking) | Qwen3-1.7B (Thinking) |

| DeepSeek-R1-Distill-Qwen-1.5B | DeepSeek-R1-Distill-Qwen-7B |

| DeepSeek-R1-Distill-Qwen-1.5B | Skywork-OR1-Math-7B |

| DeepSeek-R1-Distill-Qwen-7B | DeepSeek-R1-Distill-Qwen-14B |

| Qwen3-1.7B (Thinking) | Qwen3-4B (Thinking) |

| Qwen3-1.7B (Non-thinking) | Qwen3-4B (Non-thinking) |

| Qwen3-1.7B-SFT (Thinking) | Qwen3-4B (Thinking) |

| Qwen3-1.7B-SFT (Non-thinking) | Qwen3-4B (Non-thinking) |

| Qwen3-1.7B-SFT (Non-thinking) | Qwen3-4B-Non-Thinking-RL-Math |

| Qwen3-1.7B-Base | Qwen3-4B (Non-thinking) |

| Qwen3-1.7B-Base | Qwen3-4B-Base-GRPO |

如果一定要用一句话来概括这篇工作的价值,我会说:我们是在整个社区对于OPD的热情持续高涨的时候,试图给OPD泼冷水。 虽然免费的Dense Reward值得让我们欢欣鼓舞,但是正如天下没有免费的午餐,Token 级别的监督信号并非天然可靠。

在当前大模型技术追求快速迭代和 Scaling Law 的大环境下,我们选择回归底层,去系统地拆解并重构这些已成为“业界共识”的技术细节。我们始终坚信,只有建立在对底层机制深刻理解基础上的算法设计,才能在面对不断演进的模型架构和数据环境时,保持长久的生命力。

最后,我们由衷希望这些关于训练动力学的发现,能为社区在构建更高效、更稳定的模型对齐方案时提供一些参考。如有疑问欢迎在评论区交流!觉得写的不错的也可以点点赞同和收藏,谢谢大家!